Gemma — нейросеть от Google: открытая сила на вашем железе

В мире больших языковых моделей давно сложилось два лагеря: мощные проприетарные сервисы вроде ChatGPT или Gemini и открытые модели, которые можно запустить на своем компьютере. Особняком стоит Gemma — нейросеть от Google DeepMind. Это полноценное инженерное решение, основанное на той же базе, что и закрытый Gemini, но с фокусом на свободную лицензию, приватность и локальную работу.

Название нейросети происходит от латинского «gemma» — драгоценный камень, что точно отражает концепцию: небольшие по размеру, но очень «плотные» по интеллекту модели.

Что такое Gemma и для чего она применяется

Gemma AI — это семейство больших языковых моделей с так называемыми «открытыми весами». «Вес» на индустриальном жаргоне означает «сумму интеллекта» модели, собранную в одном файле. Этот файл вы можете скачать, после чего модель запустится на вашем сервере или ПК даже без доступа в интернет. Дальше делайте с ней что хотите: подключайте дополнительных агентов, дообучайте под свои задачи и даже используйте в коммерческих продуктах — лицензия Apache 2.0 разрешает.

Основные задачи, под которые разрабатывалась Gemma:

- генерация текста, в том числе по-русски;

- суммаризация документов;

- написание кода;

- работа с рассуждениями;

- создание агентов с вызовом внешних инструментов;

- мультимодальный анализ изображений, аудио и видео.

Да, Gemma — модель мультимодальная. Она принимает текст, изображения с переменным разрешением, видео до 60 секунд и аудио до 30 секунд, а также схемы и сканы. Но сама генерировать медиа не умеет.

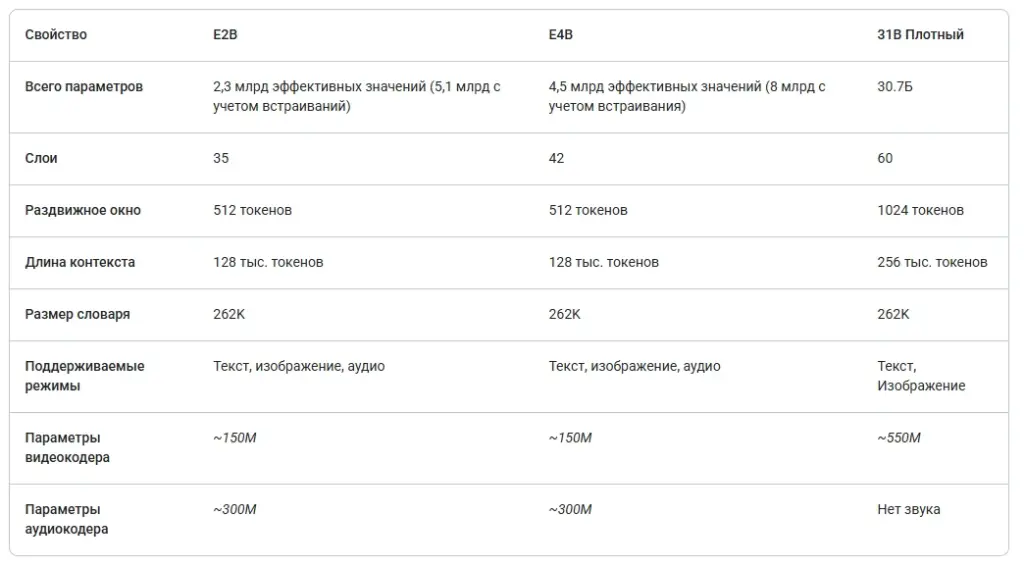

Версии Gemma 4: от смартфона до сервера

Семейство Gemma 4, самое актуальное на момент написания обзора, представлено четырьмя вариантами под разные цели:

- Gemma 4 E2B с 2,3 млрд параметров — для встраиваемых систем и самых слабых устройств;

- Gemma 4 E4B с 4,5 млрд — оптимальна для смартфонов и edge-устройств;

- Gemma 4 26B A4B — баланс скорости и качества;

- Gemma 4 31B Dense — плотная модель для максимальной производительности на мощном железе.

Все модели доступны бесплатно в предобученном и instruction-tuned вариантах, легко квантизируются до 4-8 бит и запускаются через Hugging Face, Ollama или Google AI Edge.

Благодаря такому разнообразию локальный запуск Gemma возможен на всем диапазоне платформ, от edge-устройств до серверов. В российских реалиях это часто дешевле и безопаснее облачных API. Данные компании никуда не уходят — это огромный плюс для банков, медицины, юрфирм и госструктур.

Примеры использования для личных целей и бизнеса

Достоинства Gemma многочисленны и допускают широчайший спектр применения. Прежде всего привлекает полная открытость и приватность — лицензия Apache 2.0 позволяет запускать модель полностью на локальном контуре.

Хорошая эффективность, особенно 26B MoE и 31B, версии показывают сильные результаты в reasoning и длинном контексте. Это удобно для работы с большими корпоративными базами документов. Мультимодальность модели полезна в производстве, ритейле, медицине.

Кому особенно пригодится:

- разработчикам и стартапам, которым важна экономия на API;

- компаниям с жесткими требованиями к приватности;

- исследователям;

- энтузиастам с обычными ноутбуками и даже владельцам Raspberry Pi.

Вот несколько перспективных направлений, где вам пригодится эта локальная нейросеть.

Для личных целей:

- локальный чат-бот-помощник, который работает в поезде или на даче без интернета;

- автоматическая расшифровка и суммаризация лекций или видео;

- помощь в написании текстов, писем или творческих работ с полной приватностью;

- анализ личных фотографий и документов без загрузки в облако.

Для бизнеса:

- корпоративная RAG-система на базе внутренней документации, где данные не покидают контур компании;

- автоматизация поддержки клиентов с сохранением полного контроля над логикой;

- извлечение данных из сканов, накладных и договоров;

- разработка агентов для бронирования, заказа материалов или внутренних согласований;

- генерация кода и технической документации внутри закрытого периметра.

Опыт практического использования

Мы проанализировали отзывы в русскоязычном сообществе. На Habr и в телеграм-каналах про локальные LLM оценки Gemma AI преимущественно позитивные. Пользователи отмечают, что модель очень хорошо говорит по-русски, хвалят скорость работы на среднем железе и стабильность.

Критика в основном связана с тем, что в программировании Gemma 4 уступает даже Qwen 3.5 и DeepSeek, не говоря уже о лидерах вроде Claude Code или Codex от ChatGPT. Тем не менее, для локального использования это одна из лучших открытых моделей в 2026 году.

Как Gemma справляется с RAG-сценариями

По отзывам пользователей, на сложных сценариях в системах с RAG модель иногда начинает галлюцинировать. Казалось бы, странно — ведь технология RAG по самой своей природе должна минимизировать «отсебятину» ИИ-моделей. Но у данной модели есть особенности:

- Gemma в целом склонна менее строго придерживаться предоставленного контекста по сравнению с Qwen 3.5 или некоторыми Llama-вариантами;

- Она более «разговорчивая» и творческая, поэтому охотнее дополняет ответы, и случается, что «Остапа понесло». Особенно это проявляется в сложных или длинных RAG-задачах с большим количеством документов;

- Меньшие версии — E2B и E4B — галлюцинируют заметно сильнее: не хватает «веса» для точного reasoning’а.

Тем не менее, Gemma часто успешно применяется в корпоративных RAG-системах. Там, где критична максимальная точность, она не всегда будет лучшим выбором. Но в независимых тестах, когда хорошо настроен retrieval-слой, включая российские RAG-бенчмарки, сборки на базе Gemma иногда показывают результаты на уровне или даже чуть выше топовых конкурентов. Она хорошо работает в on-device RAG, внутренних помощниках, обработке документов, даже в медицинских системах и инцидент-менеджменте.

| Сценарий | Подходит ли Gemma? |

|---|---|

| Приватный on-premise RAG | Отлично |

| Мультимодальный анализ документов | Очень хорошо |

| Максимальная точность: медицина, юриспруденция, финансы | Хорошо, но с доработками |

| Edge / мобильные корпоративные помощники | Отлично (E2B/E4B) |

| Простой чат по внутренним базам знаний | Хорошо |

| Критично минимум галлюцинаций без сложного тюнинга | Средне |

Общий вывод: Gemma не «плоха» для корпоративного RAG — она просто требует хорошей инженерной обвязки: качественная проработка взаимодействия с датасетом, строгие промпты, постпроцессинг. Впрочем, сегодня успех любой RAG-архитектуры на 70–80% зависит не от самой модели, а от всей системы вокруг нее.

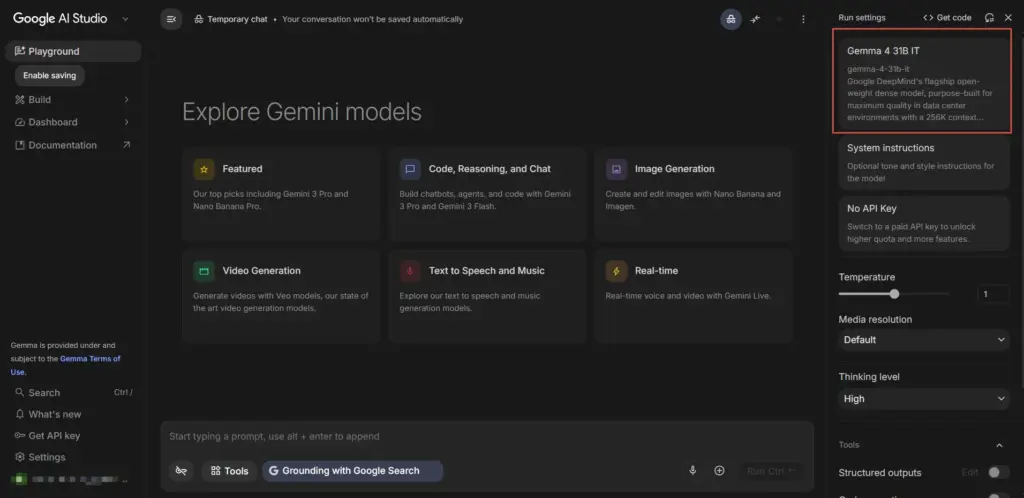

Где доступна Gemma и как ее скачать в России

Если вас заинтересовала нейросеть Gemma, скачать и использовать ее в РФ можно без каких-либо ограничений. В данном случае Google не давит геоблокировками, а выкладывает открытые веса под лицензией Apache 2.0. Это значит, что модель доступна на территории РФ напрямую.

Основные способы получения и запуска:

- Hugging Face — официальная коллекция моделей Gemma от Google. Просто скачиваете веса и запускаете локально.

- Ollama — самый простой вариант для обычного пользователя. Команда ollama run gemma4 загрузит и запустит модель оффлайн.

- LM Studio, Kubernetes, Docker и другие локальные фронтенды.

- Google AI Edge — для запуска на мобильных устройствах.

Онлайн-песочница Google AI Studio, где модель можно попробовать без скачивания, может быть недоступна напрямую из РФ. Но для самой Gemma это не критично — веса открыты, и вы полностью независимы от облачных ограничений.

- Топовая эффективность 31B-версии по бенчмаркам

- Полная открытость под лицензией Apache 2.0

- Поддержка 140+ языков с учетом культурного контекста

- Работает на слабом железе, легко квантизируется

- Полная приватность и offline-режим

- Доступность для российских пользователей

- Галлюцинирует в сложных RAG-задачах

- В кодинге и сложных агентных сценариях уступает лидерам рынка

- Сильный разрыв в эффективности между старшими и младшими версиями

- Старшие версии очень требовательны к ресурсам

Вывод

Gemma — нейросеть нового типа. Редкий случай, когда технологический гигант выпустил действительно открытый и свободный продукт, не привязанный к своей облачной экосистеме. Да, она не идеальна в кодинге и иногда галлюцинирует — с другой стороны, ИИ без галлюцинаций пока не изобрели. Но для текстовых задач, анализа документов, построения корпоративных RAG-систем и работы на edge-устройствах это надежный и высокопроизводительный инструмент. Если вы ищете открытую локальную ИИ-модель, которую можно реально использовать в России без танцев с бубном — начните с Gemma.

❓ Часто задаваемые вопросы

Ответы на актуальные вопросы об этом ИИ инструменте